隨著韓國捲起「AI 換臉」風暴,受害者多為韓國女性,不分年齡、職業、關係,大多數製作深偽色情片的犯罪者大多都是青少年,涉案人數可能多達數十萬(以 Telegram 群組統計),被政客形容為「國家危機」。韓國女性為求引起全球關注,除了常用的社群平台,甚至跑到中國微博發文,希望更多人關注事件。

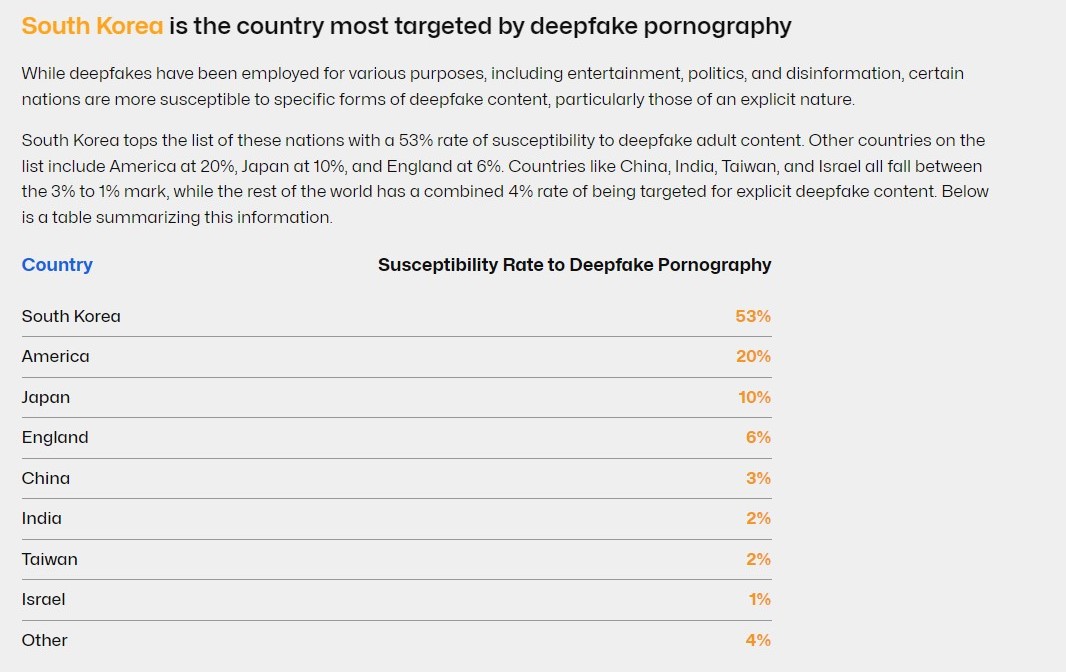

根據網絡安全公司 Security Hero 一份「2023 年 Deepfake 調查報告」,「深偽技術性犯罪」涉及合成和傳播帶有女性(包括未成年人)面孔的色情圖像,其中一半(53 %)受害者是韓國女藝人。除了重災區韓國之外,台灣(2 %)也榜上有名。

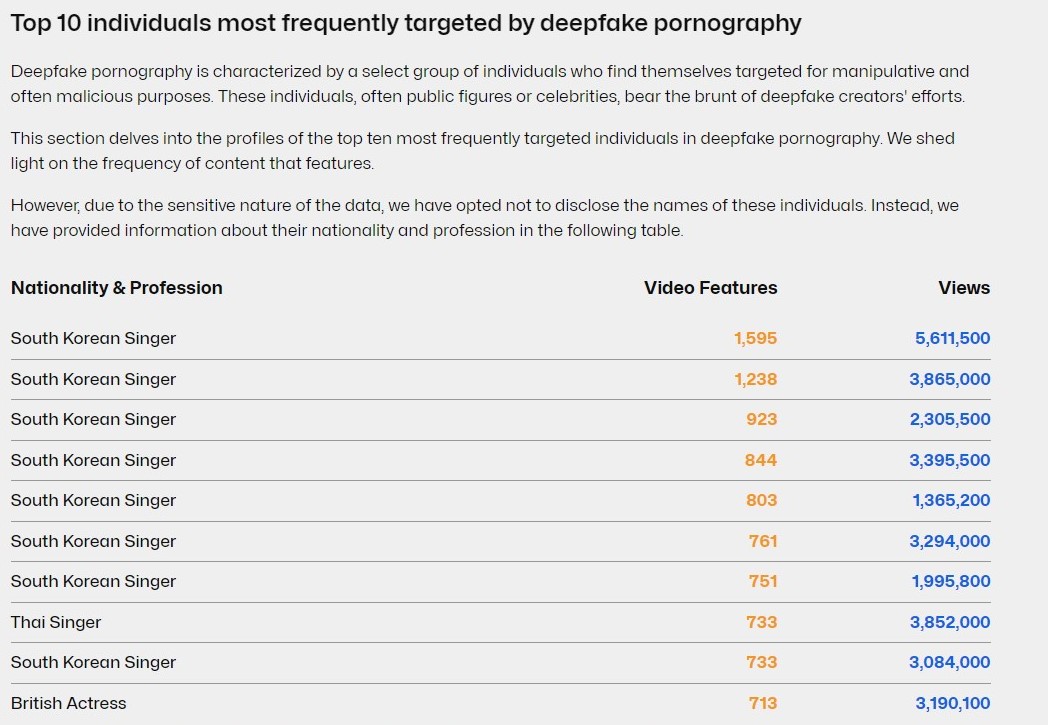

總括來說,Deepfake 色情片受害者 99% 是女性,當中 94 %是演藝界從業人員。該報告書列出最常成為目標的 10 人,其中 8 名是韓國歌手。 第1 ~ 7 位和第 9 位是韓國歌手,第 8 位是泰國歌手,第 10 位是英國演員,但受害者的身份未有公開。

目前韓國女性、K-POP 圈粉絲在社群平台 X 發起運動,要求韓國各大經紀公司盡力保護旗下女藝人,JYP Ententainet 是第一間作出回應的公司:

我們對最近涉及旗下藝人的深度偽造(AI 生成)影片的傳播表達嚴重關切。這是公然違反法律的行為,我們正在收集所有相關證據,與一家知名律師事務所一起採取強而有力的法律行動,絕不手軟。我們想明確表示,當我們的藝人的權利受到侵犯時,我們不會袖手旁觀,並將採取果斷行動,盡最大可能解決這個問題。

딥페이크 (AI 기반 합성) 영상물 확산에 대한 대응 관련https://t.co/wipV8pJJWv

— TWICE (@JYPETWICE) August 30, 2024